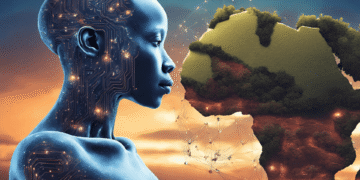

L’émergence de l’intelligence artificielle marque une rupture radicale dans l’histoire des conflits, transformant la guerre en une équation mathématique de haute précision. Désormais, les algorithmes de ciblage et les systèmes d’armes létaux autonomes (SALA) redéfinissent les enjeux stratégiques en remplaçant l’intuition humaine par une puissance de calcul phénoménale. Cette course à la technologie ne cherche plus seulement la victoire, mais une domination computationnelle où la vitesse de décision dépasse les capacités de réflexion d’un état-major classique, faisant basculer les rapports de force mondiaux dans une ère d’instabilité permanente.

Cette évolution technologique engendre une forme de guerre “sans état d’âme”, où la distance physique et émotionnelle entre l’attaquant et sa cible est totale. En confiant le droit de vie ou de mort à des lignes de code, nous assistons à une érosion du Droit International Humanitaire (DIH). Là où un soldat peut faire preuve de discernement, de pitié ou de retenue face à une situation ambiguë, la machine exécute froidement sa programmation.

Cette déshumanisation du combat rend la distinction entre combattants et civils de plus en plus floue, transformant les principes éthiques de la guerre en de simples variables souvent sacrifiées sur l’autel de l’efficacité opérationnelle.

Le danger majeur de cette automatisation réside dans l’opacité des systèmes et le risque de conséquences incalculables en cas d’erreur. Un biais algorithmique, une faille de sécurité ou une mauvaise interprétation des données par une IA peut déclencher des frappes dévastatrices sur des cibles erronées en quelques millisecondes. Contrairement à l’erreur humaine, l’erreur machine est systémique et se propage à une échelle industrielle sans qu’un “bouton d’arrêt” efficace puisse intervenir à temps. Cette perte de contrôle soulève la question de la responsabilité juridique : qui juger lorsqu’un algorithme commet un crime de guerre ?

Enfin, cette dépendance technologique crée un environnement où l’escalade imprévue devient la norme. La rapidité des réactions automatisées pourrait entraîner des nations dans des conflits globaux par simple effet de boucle rétroactive, sans qu’aucune volonté politique n’ait eu le temps de médiatiser la crise. En déléguant notre survie à des processeurs, nous risquons de transformer la planète en un laboratoire de tests pour des technologies hors de contrôle, où le coût humain ne sera plus qu’une statistique résiduelle dans un rapport de dommages collatéraux.